지금 내 앞에 있는 상대방의 마음을 읽을 수 있는 영화와 같은 일이 실제로 일어난다면 어떨까요?? 실제로 최근 캠브리지 대학과 MIT 미디어랩이 사람의 마음을 읽을 수 있는 안경을 공동개발했다고 합니다.

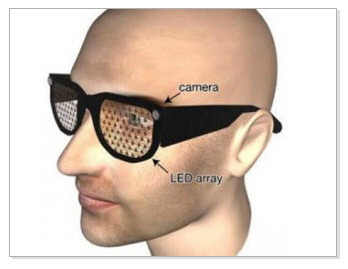

[ 이미지출처 : Coolest Gadgets ]

타인과의 소통이 어려운 자폐증 환자를 위해 개발된 것으로 알려진 이 안경에는 카메라가 탑재되어 있어 웃음이나 눈썹, 입술 움직임 등 대화하는 상대방의 24가지 표정을 잡아낼 수 있다고 합니다.

이런 표정들의 움직임을 통해 상대방의 본심이 무엇인지를 읽어내는 원리라고 하는데요.

이 안경을 개발한 캠브리지 대학의 레나 칼유비 박사팀은 감정적인 교류가 어려운 자폐증 환자를 연구해오면서 사람 표정 속에 드러나는 심리상태를 조사했다고 합니다.

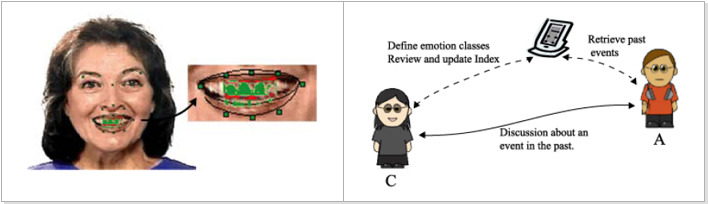

그 결과 표정 속에 나오는 사람의 심리상태를 '생각 중', '동의', '걱정', '혼란', '흥미', '비동의' 등 6가지로 분류해 소프트웨어를 제작했으며 여기에 MIT 미디어랩의 기술이 더해져 이러한 안경이 개발되었다고 하네요~

[ 이미지출처 : R.EI kaliouby and P.Robinson의 'The Emotional Hearing Aid' ]

작동 구조 또한 간단하다고 하는데요. 헤드셋의 안경 부분에 부착된 소형 카메라에 의해 상대방의 표정을 촬영하고, 촬영된 사진은 연결된 휴대용 컴퓨터에 보내진다고 합니다.

상대방의 표정으로 분석된 지루해하거나 짜증을 내는 감정들은 장치 착용자에게 신호등 모양의 신호로 알려지는데요.

전등에 빨간 불이 들어오면 상대방의 기준이 좋지 않은 것이며, 노란 불이 들어오면 중간

정도의 기분상태, 또 녹색불이 들어오면 상대방의 기분이 좋은 것을 의미한다 하네요.

아직은 이 안경을 사용했을 때 일반인의 표정에서 감정을 식별하는 정화도는 64% 정도로 실험 단계이기는 하나 감정이 풍부한 배우를 상대할 때는 정확도가 90%에 이르렀다고 합니다.

연구원들은 안경 렌즈에 직접 정보가 표시되도록 해 상대방이 무엇을 생각하는지 한 눈에 알 수 있도록 하는 기술을 개발하고 있다는데요. 안경에 부착된 일반 카메라 대신 컴퓨터에 연결된 웹 카메라를 사용해 멀리 떨어진 상대방과의 대화도 가능하도록 할 계획이라고 합니다.

연구진팀에 의하면 이 기술은 개인적으로는 절대 사용해서는 안 되며 상대방의 동의 아래

마케팅용으로 사용될 예정이라고 하는데요^^

영화에서나 나올법한 이야기가 이렇게 실제로 이루어진다니 정말 신기하네요.

현재는 3가지의 색으로 감정을 표현하지만, 앞으로 더 많은 연구와 노력을 기울인다면 인간의 감정 전달방식이 더 다양해질 수 있는 날이 올것 같습니다.