인터페이스(interface)란 어떠한 목적을 위해 사

사용자 인터페이스의 변천사! :CUI →GUI→NUI

▲CUI - Command Prompt 시동 화면 (출처: Microsoft)

▲CUI - Command Prompt 시동 화면 (출처: Microsoft)

컴퓨터가 스스로 인간과 같은 대화 혹은 커뮤니케이션을 할 수 없기 때문에 등장한 UI(User Interface). UI의 방식으로는 CUI, GUI, NUI로 구분된다. CUI(Character User Interface)는 UI 중 가장 시초로 들 수 있는데 검은색 화면에 텍스트로 명령어를 입력해서 컴퓨터를 조작하는 방식이다. 키보드로 글자를 치고 원하는 프로그램을 실행하는 방식이기 때문에 CUI에서 마우스는 사실상 필요 없는 장치이다. 명령어를 외워 직접 입력해야 하는 번거로움이 있지만 당시에는 컴퓨터와 대화하는 유일한 방법으로 사용되었다. 대표적인 CUI 방식의 운영체제로는 유닉스(UNIX)의 셀, DOS(disk operating system)의 명령 프롬프트가 있다.

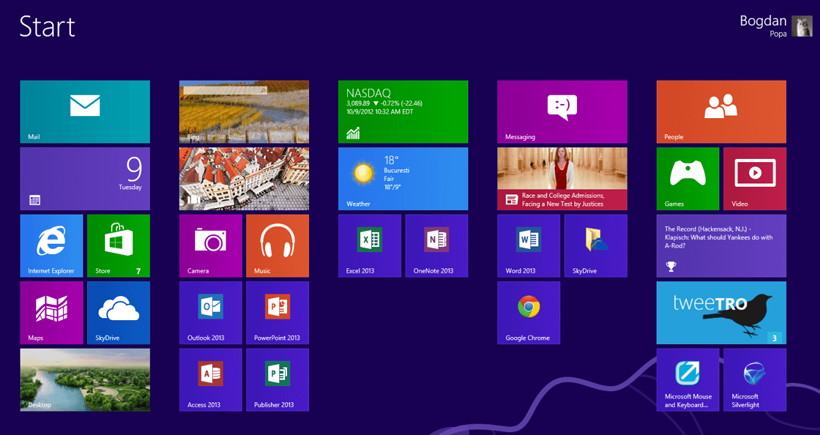

▲GUI - Microsoft사의 windows10 운영 체제 (출처: https://www.minitool.com/lib/

▲GUI - Microsoft사의 windows10 운영 체제 (출처: https://www.minitool.com/lib/

CUI에서 발전된 단계인 GUI(Graphic user interface)는 사용자가 편리하게 사용할 수 있도록 입출력 등의 기능을 알기 쉬운 아이콘 등의 그래픽으로 나타낸 것이다. 이때부터 키보드와 함께 마우스도 사용 가능하도록 인터페이스가 바뀌기 시작했다. GUI의 동작은 일반적으로 그래픽 요소의 직접 조작을 통해 수행되는데, 마우스 등을 이용해 화면에 있는 메뉴를 선택하는 작업이 그 예이다. 우리에게 친숙한 Windows와 애플사의 MAC 운영 체제들이 그래픽 사용자 인터페이스를 지원한다. 요즘 스마트폰에 적용되는 터치 화면도 GUI라고 말할 수 있다.

다음으로 NUI(Natural User Interface)은 자연스러운 상호작용에 의한 사용자 인터페이스로 마우스나 키보드 등 별도의 장치 없이 사람의 감각이나 행동, 인지능력을 통해 자연스럽게 디지털 기기를 제어하는 환경을 말한다. 기존의 마우스나 키보드처럼 사용자가 결정해서 선택하지 않아도 사용자의 의사를 맞추면서 컴퓨터를 사용할 수 있도록 한다. 센서 기술과 인공지능 기술이 발전함에 따라 사용자의 행동을 직접 입력할 수 있게 되면서 주목받고 있는 인터페이스이다. 이러한 인터페이스 방식은 이제 인간과 같은 커뮤니케이션 방식의 NUI 형태로 진화하고 있으며 AI, 멀티 터치, 크게는 증강현실 등으로 발전하고 있다.

접촉식 NUI vs 비접촉식 NUI

NUI(Natural User Interface) 기술은 사람의 신체를 기준으로 접촉식 NUI와 비접촉식 NUI로 크게 구분된다. 접촉식 NUI로는 대표적으로 웨어러블 와치를 예를 들 수 있으며, 멀티 터치를 포함해 헤어밴드, 이어폰, 안경 등이 있다. 기기를 몸에 부착하기 때문에 개인의 신체 정보, 위치, 움직임으로 다양한 연동이 가능하고, 체온의 변화나 심장박동의 변화를 체크할 수 있어 생체신호 모니터링에 적합한 형태로 원격의료의 기반기술로도 활용되고 있다. 장치를 개인화할 수 있다는 장점이 있지만 신체에 착용해야 된다는 불편함이 있다.

또한 해당 기술은 시각적, 청각적 정보가 갖지 못하는 촉각 정보 만이 갖는 독특한 감성을 전달할 수 있어 앞으로 모바일 기기의 사용성을 극대화하기 위한 요소 기술로 평가된다. 예를 들어 다중 진동자에 의한 진동 패턴의 변화는 손 떨림과 같은 사용자의 미묘한 감정 변화를 상대편에게 전달할 수 있으며, 또 촉감 이외에도 힘을 반영할 수 있는 조이스틱과 같이 사용자의 역감(力感) 표현을 위해서도 이 기술은 사용될 수 있다. 현재는 터치스크린을 이용하여 버튼이나 아이콘을 조작할 때 짧은 진동을 가해 버튼을 누르는 촉감을 강조해 주는 단편적인 기술로 응용되고 있다.

비접촉식 NUI는 신체 접촉 없이 공기를 통해서만 사용되는 형태로 대부분 동작인식 기반 기기를 의미하는데 고정된 기기, 고정된 장소에 장착할 수 있으며 접촉식 NUI와는 다르게 개인화를 하려면 많은 정보를 처리해야 한다는 차이점이 있다.

원거리에서 사람의 움직임을 알아차리고 아무런 접촉 없이 시선, 음성인식을 통해 취향, 관심사에 맞는 콘텐츠를 제공할 수 있고 사람의 홍채인식, 안면인식, 음성인식 등을 통해서도 사용자와 인터페이스를 할 수 있다. 특별한 학습과정 없이 손짓, 몸짓, 말만으로도 IT기기를 사용할 수 있어 컴퓨터 보다는 사람의 대화 방식에 가까운 기술이다. 컴퓨터와 대화를 위한 사용자 인터페이스가 사람의 생활 방식을 닮아가고 있다고 볼 수 있다.

현재 시중에 나와있는 기기로는 우리에게 친숙한 안드로이드 운영체계의 ‘OK google’, 스마트 스피커 서비스인 ‘Hey KaKao’를 예를 들 수 있다. 음성명령으로 관련 내용을 호출하는 대화형 개인비서 서비스의 형태로 대중화를 이루고 있다.

&feature=youtu.be

▲현실과 가상이 공존하는 증강현실, 어떤 분야에 적용할 수 있나? (출처:YTN 사이언스)

차세대 인터페이스 기술, 사람의 생각을 읽는 ‘BCI’, ‘BMI’

▲투데이 키워드 - BCI, 뇌 컴퓨터 인터페이스 (출처: 뉴스토마토)

그렇다면 앞으로 다가올 차세대 인터페이스는 무엇일까? BCI(Brain-Computer Interface), BMI(Brain-Machine Interface) 기술은 사람의 뇌파를 분석해 전자기기를 자동 제어할 수 있어 차세대 인터페이스로 주목받고 있다. 프랑스 스타트업 넥스트마인드는 ‘CES 2020’에서 사람의 생각을 읽는 웨어러블 헤드셋을 선보여 주목받았다. 헤드셋을 착용하면 생각만으로도 조명의 색을 바꿀 수 있고 TV 채널도 변경이 가능하다.

▲웨어러블 헤드셋 (출처:넥스트마인드 홈페이지)

▲웨어러블 헤드셋 (출처:넥스트마인드 홈페이지)

또한 BCI · BMI 기술은 신체를 완전히 움직이지 못하는 환자를 움직이는 기술로 활용될 수 있다. 실제로 피츠버그 의료 대학 연구진은 환자의 뇌에 임플란트 수술을 시행해 로봇 손의 감각과 환자의 뇌를 연결했다. 환자는 눈을 감고 어떤 손가락에 압력이 가해졌는지 느낄 수 있었는데, 이는 로봇에 가해진 충격을 전기 신호로 변환하면 환자의 뇌가 이것을 수용해 실제 감각이 느껴지는 것이다. 이렇게 BCI · BMI 기술로 지금은 치료하기 어려운 질병도 뇌파를 이용해 치료할 수 있을 것으로 전망하고 있다.

마케팅 분야에서도 유용하게 활용될 수 있다. 뇌 속에서 정보를 전달하는 뉴런(Neuron)과 마케팅의 합성어로 ‘뉴로마케팅(Neuron Marketing)’으로 불리는데, 기존 마케팅 조사 방식을 뛰어넘어 소비자가 지각하지 못한 무의식적 반응, 두뇌 자극 활동을 분석해 마케팅에 접목하는 방식이다. 뇌의 신호로 사람의 의도나 감정을 실시간으로 예측할 수 있어 해당 기술을 마케팅 분야에서도 BCI 관련 기술이 활용되고 있다. 실제 P&G는 섬유탈취제인 페브리즈 출시 전 소비자 뇌 반응을 측정해 소비자의 니즈에 맞는 제품을 출시할 수 있었고, 유니레버는 소비자 뇌 반응 분석으로 초콜릿 바 아이스크림이 초콜릿이나 요구르트보다 더 만족감을 주고 있다는 사실을 발견했다.

이 밖에도 키보드나 터치패드를 사용하지 않고 문자를 컴퓨터에 입력할 수 있는 기술, 뇌파를 통해 조정할 수 있는 드론 등 차세대 인터페이스 기술을 적용한 제품을 시장에 출시하기 위한 연구들이 활발하게 진행되고 있다. 개인의 프라이버시가 노출될 가능성이 있어 어느 정도 한계점이 있지만 BCI와 관련된 시장이 매년 평균 11.5%씩 성장해 올해는 그 규모가 14억 6000만 달러에 이를 것으로 전망되고 있는 만큼 앞으로 다양한 산업과 관련해 많은 사람들에게 도움이 되는 기술로 발전하길 기대해본다.

※ 이 칼럼은 해당 필진의 개인적 소견이며 삼성디스플레이 뉴스룸의 입장이나 전략을 담고 있지 않습니다.