세상 최고의 화질은 누가 뭐래도 ‘제 눈앞’이다. 아무리 초고화질 영상, 사진이라고 해 봤자 나 자신의 눈으로 보는 것보다 실감나는 건 없다. 그러나 눈앞의 장면은 휘발성이 있다. 기억으로 저장될 뿐, 인간의 눈으로 보는 것 그대로를 시공간을 넘어 다른 사람에게 보여주는 건 불가능하다. 하지만 불가능은 언제나 인간에게 정복이라는 욕구를 불러일으키기도 한다. 이러한 욕구는 더 선명하고, 더 크고, 더 실감나는 사진, 더 생생한 영상을 보여주는 고화질 해상도 기술을 진화시키는 데에도 큰 역할을 했다.

고화질 해상도란 무엇인가?

해상도(resolution)란 디지털 화면을 구성하는 각각의 면 안에 얼마나 많은 수의 픽셀(pixel)을 담았는지를 나타낸다. 여기서 픽셀은 디지털 이미지를 이루는 가장 작은 원소다. 따라서 해상도가 높을 수록 픽셀의 수가 늘어나기 때문에, 화면 크기가 같다고 하더라도 픽셀의 밀도가 높아져 화질이 좋아지는 효과가 나타난다.

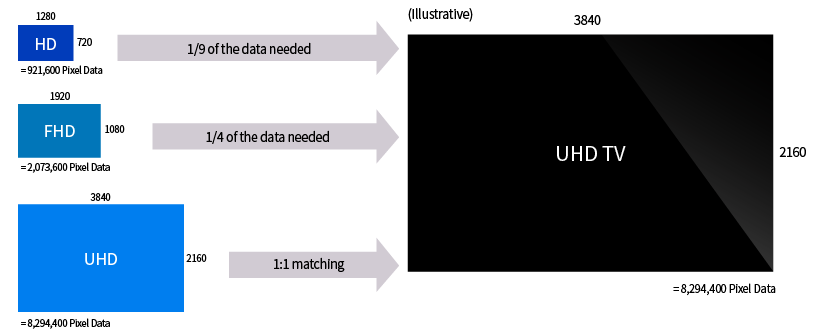

▲ 디스플레이 해상도와 픽셀 수

오늘날 TV의 진화는 해상도의 발전과 굴레를 같이 한다. 화면 하나에 담는 픽셀 수는 SD(720×480)에서 HD(1280×720)로 발전했다. HD는 FHD(1920×1080)로, 다시 4K UHD(3840×2160)와 8K UHD(7680×4320)로 진화하고 있다. 정해진 공간 안에 픽셀의 수가 늘어난다는 건 그만큼 더 세밀하게 표현할 수 있게 된다는 뜻이다. 같은 화면 크기라도 픽셀 수가 더 많아진다면 더 선명해진다. 즉, 고화질 해상도란 더 풍부한 디테일을 담을 수 있다는 것이다.

해상도는 하드웨어에서만 쓰이지 않는다. 화면에 담기는 디지털로 이뤄진 모든 콘텐츠가 해상도를 갖는다. 콘텐츠와 하드웨어가 동일한 픽셀의 밀도를 가졌다면 각각의 해상도가 1:1 매칭이 되므로 최선의 화면을 보여준다. 그러나 콘텐츠와 하드웨어의 해상도가 다르면 문제다. 만약 콘텐츠의 해상도는 낮은데 하드웨어의 해상도는 그보다 높다면 화면이 어떻게 처리되어야 할까?

가령 4K UHD TV에서 해상도가 낮은 HD 영상을 틀게 된다면 9분의1 픽셀만 사용된다. 실제로 이렇게 둔다면 나머지 9분의 8은 아무런 이미지 정보가 없으므로 검은 화면이 나오게 될 것이다. 하지만 오늘날의 디스플레이 기기들은 화면을 완전히 채우려 저화질을 고화질로 바꿔서 보여준다. 이를 상향변환(upconversion), 상향조정(upscaling)이라 부른다. 이는 저화질 이미지를 줌인하는 것과 같다. 동일한 픽셀을 TV 픽셀수에 맞게 복제해서 화면을 채우는 방식이다. HD 화질을 UHD TV에서 업스케일링하면 원래 픽셀 1개를 9개로 복제해 UHD 화면에 채우는 것이고, FHD 화질을 업스케일링하는 경우에는 원래 픽셀 1개를 4개로 복제해 채운다. 하지만 이럴 경우 복제된 픽셀들로 인해 색상이 바래거나 흐릿하게 보이기도 하는 한계가 있다.

저화질 영상을 고화질로 바꾸는 매직, ‘AI 업스케일링’

▲FHD 영상(좌)과 AI 업스케일링된 8K 영상(우): 시청자에게 가까운 부분을 더 선명하게 처리해 보다 입체적으로 느껴진다. (출처: 삼성전자 뉴스룸)

수년 전 TV 제조사들은 픽셀을 복제하는 대신, 새 픽셀로 보여줘야 하는 것을 결정하기 위해 인접 픽셀을 검토하는 방식을 발명했다. 이 조정 기술은 더 날카롭고 뚜렷한 테두리를 만들 수 있게 한다. 이후론 각 프레임에서 인접 픽셀을 보는게 아니라, 동작, 노이즈, 기타 여러 이미지의 부속물을 보기 위해 복수의 프레임을 살핀다. 이는 선명함과 노이즈 감소 등의 적정 수준을 결정하는 연산 작업을 필요로 하는데, 이때 AI가 이 작업의 효율적 수행에 도움을 줄 수 있다.

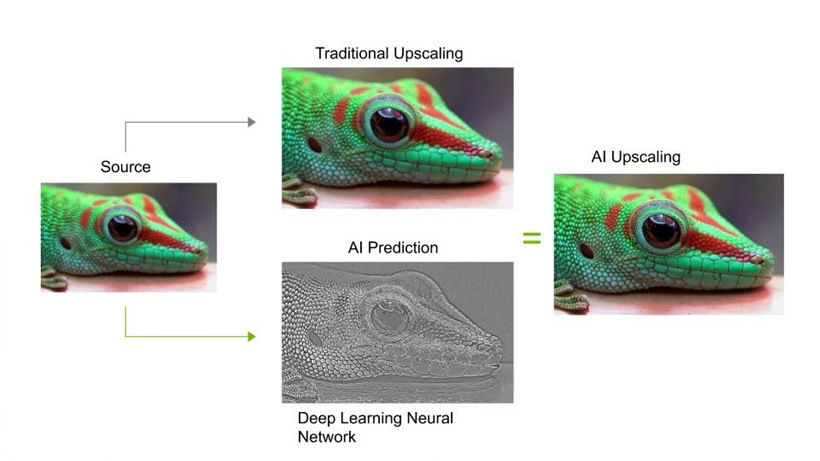

▲ 딥러닝 기반 AI 업스케일링 기술 예시 (출처: NVIDIA Korea)

AI 업스케일링은 딥러닝 기술을 사용한다. 먼저 AI가 저해상도 이미지를 인식한 후, 거꾸로 '어떠한 고해상도 이미지를 작게 축소(다운스케일링)하면 이러한 모습이 될까'를 예측하는 방식이다. 따라서 업스케일링된 이미지를 높은 정확도로 예측하려면, 수많은 이미지를 학습하고 적용 훈련을 해야 하며, 이때 뉴럴 네트워크 모델을 활용하면 효율이 높아진다. 많은 훈련을 할수록 AI로 끌어올린 해상도의 품질이 더 선명해지고 더 많은 디테일을 담게 된다. AI는 효과적인 업스케일링을 위해 인식한 픽셀을 분석하기도 하고, 수많은 인기 TV 프로그램과 영화의 데이터세트, 사진 등을 학습해 실시간 추론을 하기도 한다.

▲해상도에 따라 영상의 화질 차이를 보여준다.

삼성전자는 8K QLED TV에서 4K 해상도 영상을 최고 화질로 보여주기 위해 AI 업스케일링을 활용했다. TV가 수백만 개의 영상을 미리 학습하고 유형별로 분석해 자동으로 화질을 개선한다. TV 스스로 최적의 보정 필터를 찾아 저화질 영상을 고화질로 변환하며, 각 장면을 화질 특징에 따라 분류해 원작자가 의도한 세밀한 차이를 살릴 수 있도록 영역별로 명암비·선명도 등을 실시간으로 조정한다.

초고화질 해상도의 최전선, ‘이미지 센서’

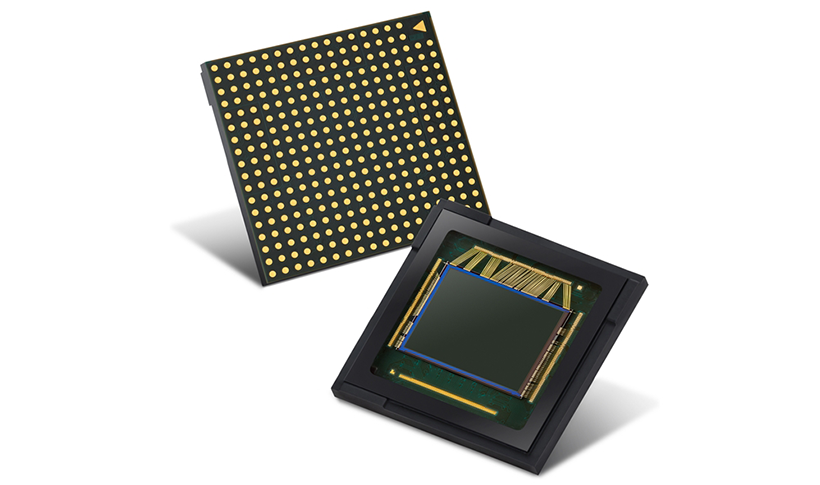

▲ 삼성전자 모바일 이미지센서 ‘아이소셀 GN1’ (출처: 삼성전자 뉴스룸)

업스케일링은 이미 만들어진 사진이나 영상을 확대하는 것에 국한되지 않는다. 촬영 순간부터 화질을 높일 수 있도록 발전하고 있는 이미지센서도 고화질로 개선하는데 한 몫 한다. 이미지센서는 반도체의 일종으로 카메라 렌즈로 들어오는 빛을 전기 신호로 바꿔주는 역할을 한다. 사람으로 따지면 망막이다. 이미지센서는 전하결합소자(CCD), 상보성 금속산화 반도체(CMOS) 이미지 센서로 나뉘는데, CMOS 방식이 CCD보다 더 적은 전력을 소모하고, 노이즈가 적어 최근 대세를 형성하고 있다.

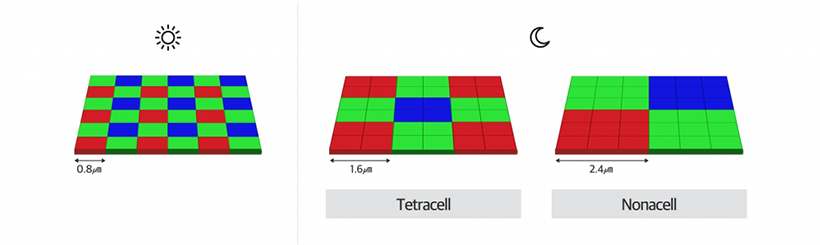

▲‘아이소셀 브라이트 HM1’ 기술을 보여주는 그림. (출처: 삼성전자 뉴스룸)

촬영하는 사진이나 영상의 화질을 높이려면 이미지센서가 많은 픽셀 수를 가지면 된다. 스마트폰 같은 오늘날의 디지털 기기는 소형화, 경량화를 추구한다. 그러므로 이미지센서는 많은 양의 픽셀을 작은 공간에 담으면서도, 받아들이는 빛의 양을 늘리는 것을 경쟁력으로 삼는다.

픽셀의 크기를 줄이면, 빛을 받아들이는 면적이 줄어들기 때문에 촬영물의 품질이 낮아진다. 삼성전자는 픽셀 광학 구조를 개선해 빛의 손실과 픽셀 간 간섭 현상을 최소화하는 '아이소셀 플러스' 기술을 개발했다. 아이소셀은 격리하다(Isolate)와 세포(cell)이 합쳐진 말로 픽셀과 픽셀 사이에 물리적인 벽을 세워 픽셀로 들어온 빛이 밖으로 나가지 않도록 한다. 9개의 인접 픽셀이 한 개의 픽셀인 듯 동작하기 때문에 어두울 때 빛을 받아들이는 면적이 9배다. 밝을 때는 1억 800만 해상도까지 선명하다.

나는 한 번이지만 카메라는 여러 번, 스마트폰 카메라와 고화질

고화질을 다르게 표현하면 높은 선명도와 많은 디테일을 담았다는 것이다. 픽셀 밀도 외에 픽셀과 픽셀의 구성이 화질을 결정하기도 한다. 최근엔 촬영 결과물을 합성해 최고의 화질을 만들어내는 기술이 스마트폰에서 사용된다.

▲'딥 퓨전 기술'이 적용된 아이폰12 Pro로 찍은 사진. 딥 퓨전 기술은 모든 카메라에 적용되어 첨단 머신러닝을 이용해 픽셀 단위로 사진을 처리하면서 사진의 모든 부분에서 디테일, 질감, 색상을 최적화한다. (출처: Apple 뉴스룸)

애플 아이폰12에 사용되는 ‘딥 퓨전(Deep Fusion)’, ‘스마트HDR’ 등이 대표적 예다. 애플의 딥퓨전은 사진 촬영 시, 카메라가 동일한 장면을 각기 다른 노출 수준으로 여러 장을 촬영하고, 피사체에 가장 적합한 노출을 적용하기 위해 각 프레임들을 병합한다. 아이폰의 카메라는 사용자가 셔터를 누르기 전후 9장의 사진을 찍으며, 한 장의 장기 노출 사진을 촬영한다. 명과 암에 최적의 픽셀을 찾아서 디테일을 더하고, 노이즈를 줄여서 HDR 이미지를 완성한다.

아이폰12 시리즈에 탑재되는 머신러닝 전용 프로세서인 ‘뉴럴 엔진’은 최적의 선명도, 색감, 명암부 표현에 적합한 픽셀을 각각 분석해 선택한다. 애플에서 설계한 ISP가 이 픽셀들을 결합해 최종본을 만들어내는 것이다. 딥퓨전 같은 기술을 활용하면 디지털줌이라도 해상도 확장에 따른 노이즈 증가를 줄일 수 있다.

업스케일링 기술의 미래

요즘 나오는 업스케일링 기술은 모두 AI 기술의 발전과 함께 빠르게 진화하고 있다. 합성곱 신경망(Convolutional Neural Network, CNN)도 이 중 하나이다. 합성곱 신경망은 이미지 처리에 탁월한 성능을 보이는 인공 신경망으로, 최근 이미지 분류, 처리 분야의 기술을 급속히 끌어올리고 있다. 특히, CNN은 이미지에서 점, 선, 면 등의 요소를 추출하는데, 이런 성질을 이용해 수많은 학습을 거치면 손실된 디테일을 스스로 판단해 복원할 수 있다.

촬영 단계부터 화질을 높일 수 있는 요소인 이미지센서는 갈수록 초박형으로 줄어들면서, 더 많은 픽셀을 담아 가고 있다. 삼성은 올해 1억 5천만 픽셀을 가진 이미지센서를 출하했으며, 향후 6억 픽셀 이미지센서도 개발할 계획으로 알려져 있다. 사람의 눈이 약 5억 픽셀인데, 그보다 높은 픽셀 수를 구현하겠다는 것이다.

눈에 보이는 그대로를 남에게 전하고 싶다는 욕구는 공감을 얻으려는 욕망에서 비롯된 것일지 모른다. 감성과 이성의 절묘한 조합으로 탄생하는 주관적 장면이, 보다 발전된 업스케일링 기술을 통해 객관적 장면으로도 바뀔 수 있는 시대가 열리길 희망한다.

※ 이 칼럼은 해당 필진의 개인적 소견이며 삼성디스플레이 뉴스룸의 입장이나 전략을 담고 있지 않습니다.